O genocídio de Israel em Gaza expôs como a “inteligência artificial” (IA) está mudando a guerra de maneiras terríveis e mortais. Com a ajuda das grandes empresas de tecnologia, Israel, juntamente com os EUA, está agora expandindo o uso de IA no Irã e no Líbano, ampliando seu campo de testes para tecnologia militar habilitada por IA — com consequências ainda mais letais.

Israel é há muito tempo um dos principais polos mundiais de desenvolvimento de IA. Em 2024, havia cerca de 2.300 startups de IA ativas em Israel, segundo um relatório do Google Israel e do RISE Israel, um think tank de tecnologia. Desde então, esse número provavelmente só aumentou, à medida que os investidores de capital de risco injetam dinheiro no setor. Aproximadamente um quarto de todas as startups de tecnologia em Israel são empresas de IA, apoiadas por bilhões de dólares em financiamento.

As gigantes da tecnologia também estreitaram seus laços com Israel, aproveitando seu ecossistema tecnológico para recrutar talentos e expandir seus negócios. A Nvidia anunciou recentemente planos para construir no norte de Israel um enorme campus tecnológico, que abrigará projetos de pesquisa e desenvolvimento em IA, e o CEO da Nvidia, Jensen Huang, descreveu Israel como a “segunda casa” da empresa.

Tudo isso aconteceu enquanto Israel ataca populações civis em Gaza, na Cisjordânia, no Líbano e no Irã.

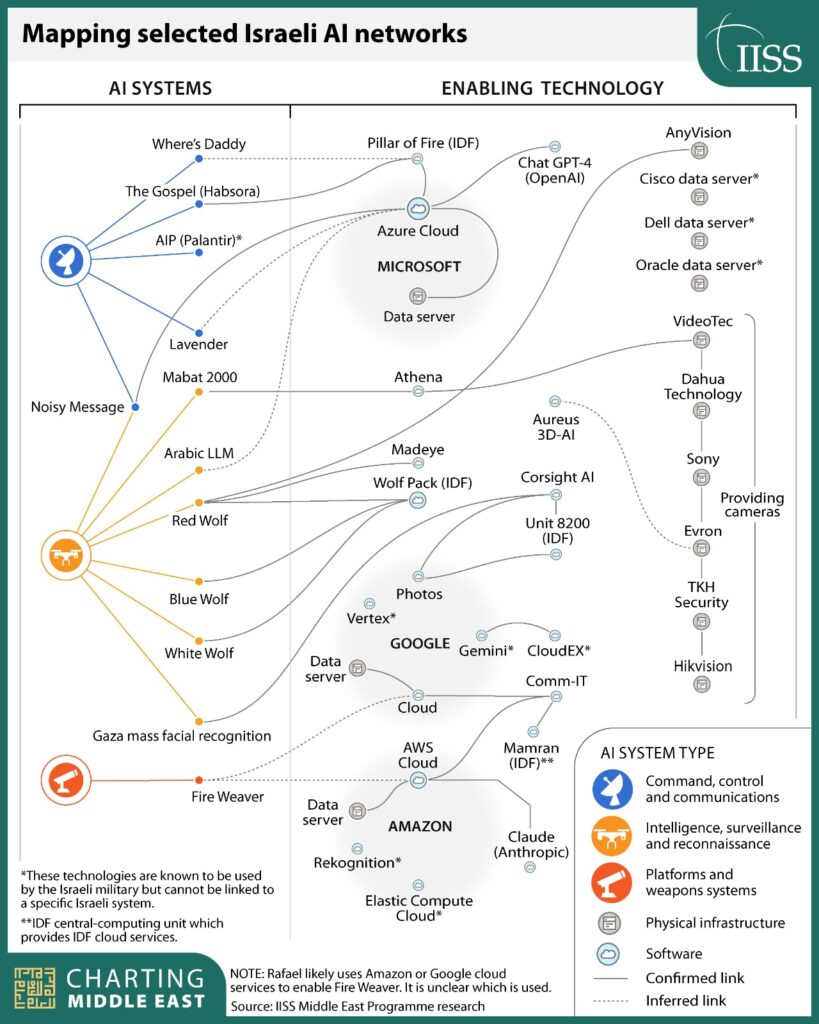

Um novo relatório do Instituto Internacional de Estudos Estratégicos (ISS), um think tank e autoridade líder em segurança global e conflitos militares, detalha exatamente o quão integrada a inteligência artificial está nos sistemas de armas e operações militares de Israel.

Segundo o relatório, Israel fez investimentos significativos para incorporar IA em suas ferramentas e sistemas militares. Esses esforços variam desde a criação de uma Administração de IA e Autonomia dentro da Diretoria de Pesquisa e Desenvolvimento de Defesa do Ministério da Defesa, até o fortalecimento da Unidade de Inteligência de Elite 8200 para desenvolver as próprias capacidades de IA das Forças Armadas israelenses.

Do “Atirador Inteligente” ao Lavender

A inteligência artificial está sendo usada para aprimorar o rastreamento de alvos e as taxas de abate de qualquer pessoa que Israel considere combatente inimigo. A empresa israelense Smart Shooter, por exemplo, desenvolveu uma mira “inteligente” com inteligência artificial que pode ser instalada em praticamente qualquer arma de fogo. Uma vez acoplada à arma, ela pode transformar um rifle padrão em uma arma de precisão muito mais letal.

Graças à tecnologia de IA, um atirador pode mirar em um alvo usando o sistema óptico SMASH da Smart Shooter, e o software irá travar no alvo e rastrear automaticamente a pessoa enquanto ela se move. Quando o atirador se prepara para puxar o gatilho, o sistema sincroniza automaticamente o disparo assim que a arma estiver apontada corretamente para o alvo. Basicamente, o gatilho é bloqueado eletronicamente até que o sistema de IA calcule que o disparo realmente acertará o alvo, tornando cada tiro muito mais propenso a ser fatal. O sistema SMASH da Smart Shooter também pode ser usado em drones.

Um dos produtos de IA mais depravados de Israel é conhecido como Lavender. Ao longo do genocídio em Gaza, Israel utilizou o Lavender, uma ferramenta de IA que agrega grandes volumes de dados sobre pessoas e aplica algoritmos de reconhecimento de padrões para identificar quem matar, muitas vezes rastreando-as e matando-as em suas casas junto com suas famílias, resultando em um número máximo de vítimas.

Segundo a revista +972 , o exército israelense utilizou esse sistema para marcar dezenas de milhares de palestinos como potenciais alvos de assassinato, e seu sistema de inteligência artificial praticamente não possui supervisão humana e parece ser extremamente permissivo em relação às vítimas.

“Segundo seis oficiais da inteligência israelense, que serviram no Exército durante a atual guerra na Faixa de Gaza e tiveram envolvimento direto com o uso de IA para gerar alvos de assassinato, o Lavender desempenhou um papel central no bombardeio sem precedentes de palestinos, especialmente durante os estágios iniciais da guerra”, relatou o +972. “Na verdade, de acordo com as fontes, sua influência nas operações militares foi tamanha que eles trataram os resultados da máquina de IA como se fossem decisões humanas.”

O relatório do ISS também destaca o uso de sistemas de reconhecimento facial por IA por Israel. Israel implementou extensos programas de reconhecimento facial tanto em Gaza quanto na Cisjordânia. Na Cisjordânia, os militares israelenses utilizam sistemas que acessam um banco de dados chamado Wolf Pack. Esse banco de dados armazena informações pessoais altamente sensíveis sobre palestinos, que são usadas para criar perfis de inteligência que são então compartilhados com a agência de segurança interna de Israel, o Shin Bet.

Os dados biométricos dos palestinos são coletados em postos de controle por todo Israel, e os soldados israelenses têm softwares afiliados ao grupo Wolf Pack instalados em seus smartphones para inserir mais palestinos em seus sistemas. Executar programas de reconhecimento facial em pessoas sem o seu consentimento em uma escala tão massiva é estritamente proibido pelas leis internacionais de direitos humanos. O direito à privacidade, inclusive em relação a sistemas de reconhecimento facial, é garantido pelo Artigo 17 do Pacto Internacional sobre Direitos Civis e Políticos (PIDCP).

Megaempresas privadas possibilitam uso militar da IA

Nenhum desses sistemas de vigilância ou armas com IA funcionaria sem o apoio do mercado comercial. Empresas americanas de tecnologia de defesa e IA, como a Palantir, lucram diretamente com seus contratos com as forças armadas israelenses. Em 2024, Israel e a Palantir assinaram uma parceria estratégica para “aproveitar a tecnologia avançada da Palantir em apoio a missões relacionadas à guerra”.

Mas também, “grandes empresas de tecnologia como Amazon, Anthropologie, Google, Microsoft e OpenAI forneceram produtos de IA para diversos ministérios da defesa, incluindo os dos EUA e de Israel”, observa o relatório do ISS. “Um rascunho de contrato de 2024 entre o Google e o Ministério da Defesa israelense destacou a ‘zona de aterrissagem’ exclusiva preexistente deste último para acessar infraestrutura em nuvem, e novos planos para criar zonas de aterrissagem específicas para unidades militares.”

O relatório também revela que, nos termos do Projeto Nimbus, as empresas estatais israelenses Israel Aerospace Industries e Rafael Defense Industries são obrigadas a usar os serviços de nuvem do Google e da Amazon para todas as suas necessidades de computação em nuvem. “Enquanto Israel é acusado de crimes de guerra, bem como crimes contra a humanidade e genocídio tanto no Tribunal Penal Internacional quanto na Corte Internacional de Justiça, o aprofundamento de sua cooperação com fornecedores comerciais pode potencialmente expô-los à responsabilidade sob as estruturas de direito nacional e internacional”, acrescenta a ISS, que cita igualmente a avaliação da Anistia Internacional.

Embora as duas maiores gigantes americanas de IA, Anthropic e OpenAI, não tenham formalmente estabelecido parcerias diretas com as forças armadas israelenses, elas já estão profundamente interligadas com suas ações militares. As forças armadas israelenses tiveram acesso ao modelo de linguagem GPT-4 da OpenAI por meio de sua parceria com a Microsoft, iniciada em agosto de 2023. O LLM é capaz de ajudar as forças armadas a analisar bilhões de informações e sintetizar dados. (No ano passado, a Microsoft teria revogado o acesso à tecnologia da Unidade 8200, a unidade de inteligência de elite de Israel, mas continua trabalhando com outras unidades das forças armadas israelenses, segundo o +972.)

Embora os termos da OpenAI inicialmente proibissem o uso de seus serviços para atividades “militares e de guerra”, a empresa removeu discretamente essa cláusula e expandiu sua parceria com as forças armadas dos EUA em janeiro de 2024, em meio à escalada dos ataques a Gaza.

A Anthropic buscou restringir o uso de seus modelos pelas forças armadas dos EUA de certas maneiras; no entanto, Claude, o principal modelo da Anthropic, está integrado aos sistemas da Palantir e teria sido usado pelas forças armadas dos EUA para identificar alvos no Irã. O relatório do ISS observa que “é de se esperar que as tecnologias militares baseadas em IA continuem a proliferar nos campos de batalha do Oriente Médio, aumentando os danos causados a civis e bens civis e exacerbando as crises humanitárias”.

À medida que as grandes empresas de tecnologia estreitam seus laços com as forças armadas dos EUA e continuam fazendo negócios com as forças armadas israelenses, o Oriente Médio permanecerá um laboratório para guerras facilitadas por inteligência artificial, e os civis inocentes em Gaza, na Cisjordânia, no Líbano e no Irã pagarão o preço pelos mais recentes experimentos de IA do Vale do Silício.

*Publicado em inglês na edição de 20 de abril do Zeteo (confira aqui). Taylor Lorenz, autor da coluna “Efeito de Rede” da Zeteo, é uma aclamada jornalista de tecnologia e cultura online.